百川智能发布开源中英文大模型 免费可商用

发布日期:2023/6/16 7:52:56 浏览量:

由王小川组队创办的AI大模型创企百川智能今日宣布推出70亿参数量的中英文预训练大模型baichuan-7B。

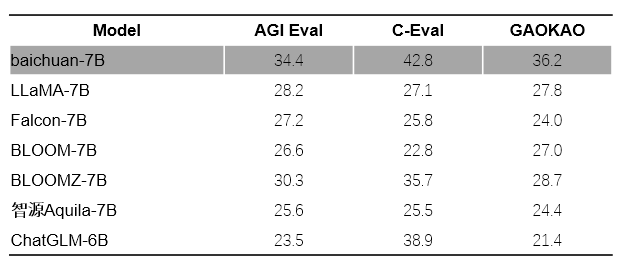

baichuan-7B不仅在C-Eval、AGIEval和Gaokao中文权威评测榜单上,以显著优势全面超过了ChatGLM-6B等其他大模型,并且在MMLU英文权威评测榜单上,大幅领先LLaMA-7B。目前baichuan-7B大模型已在Hugging Face、Github以及Model Scope平台发布。baichuan-7B在C-Eval、AGIEval和Gaokao三个最具影响力的中文评估基准进行了综合评估,并且均获得了优异成绩,它已经成为同等参数规模下中文表现最优秀的原生预训练模型。在中文C-EVAL的评测中,baichuan-7B的综合评分达到了42.8分,超过了ChatGLM-6B的38.9分,甚至比某些参数规模更大的模型还要出色。在AGIEval的评测里,baichuan-7B综合评分达到34.4分,远超LLaMa-7B、Falcon-7B、Bloom-7B以及ChatGLM-6B等其他开源模型。在GAOKAO评测中,baichuan-7B的综合评分达到了36.2分,显著领先于同参数规模的各种其他预训练模型。

baichuan-7B在英文上表现同样亮眼。在MMLU的评测中,baichuan-7B综合评分高达42.5分,大幅领先英文开源预训练模型LLaMA-7B的34.2分以及中文开源模型ChatGLM-6B的36.9分。秉持开源精神,baichuan-7B代码采用Apache-2.0协议,模型权重采用了免费商用协议,只需进行简单登记即可免费商用。baichuan-7B此次开源的内容包含推理代码、INT4量化实现、微调代码,以及预训练模型的权重。据了解,北京大学和清华大学两所顶尖高校已率先使用baichuan-7B模型推进相关研究工作,并计划在未来与百川智能深入合作,共同推动baichuan-7B模型的应用和发展。

开源地址:

Hugging Face:

https://huggingface.co/baichuan-inc/baichuan-7B

Github:

https://github.com/baichuan-inc/baichuan-7B

Model Scope:

https://modelscope.cn/models/baichuan-inc/baichuan-7B/summary 马上咨询: 如果您有业务方面的问题或者需求,欢迎您咨询!我们带来的不仅仅是技术,还有行业经验积累。

QQ: 39764417/308460098 Phone: 13 9800 1 9844 / 135 6887 9550 联系人:石先生/雷先生